2024년 8월 석사를 졸업하고, 2025년 1월에는 학문적 여정의 큰 이정표였던 NAACL 논문 억셉 소식을 들을 수 있었습니다.

이후 3월부터는 본격적으로 취업 준비에 뛰어들었고, 총 24곳(부트 캠프 2곳 포함)에 지원하며 치열한 시간을 보냈습니다. 그 과정에서 15곳은 서류 단계에서 탈락했고, 억울한 경험도 몇 차례 있었지만, 결국 원하던 분야에서 최종 합격이라는 결과를 얻을 수 있었습니다.

짧다면 짧지만, 제게는 정말 길고 힘들게 느껴졌던 6개월이었습니다. 이번 글에서는 그 과정을 정리하며 되돌아보고자 합니다.

AI와의 첫 만남

저는 하고 싶은 일이 있으면 일단 도전부터 해보는 성격입니다.

수학을 그나마 잘해서 전자공학부에 진학했지만, 정작 전공 수업은 저와 맞지 않았습니다. 회로나 반도체 같은 과목들은 도무지 흥미가 생기지 않았습니다.

그러던 중, 3학년 때 코로나가 터졌습니다. 갑작스레 모든 게 멈춘 듯한 시기였는데, 오히려 저는 학교에 가고 싶다는 생각이 들었습니다. 그래서 아무 생각 없이 한 연구실에 학부 연구생(알바)으로 들어가게 되었죠.

그때는 매일 커피 심부름이나 하며 의미 없는 시간을 보내고 있었는데, 어느 날 학과 사무실 앞 벽보에서 ‘인공지능’이라는 단어를 보게 되었습니다.

“어? 내가 아는 인공지능은 터미네이터밖에 없는데…?”

회로 공부는 하기 싫던 차에 호기심이 동해 무작정 인공지능을 연구하는 자대 연구실을 찾아갔습니다. 마침 학부생 연구 프로그램(UROP, 3학점)이 열려 있었고, 바로 지원했습니다.

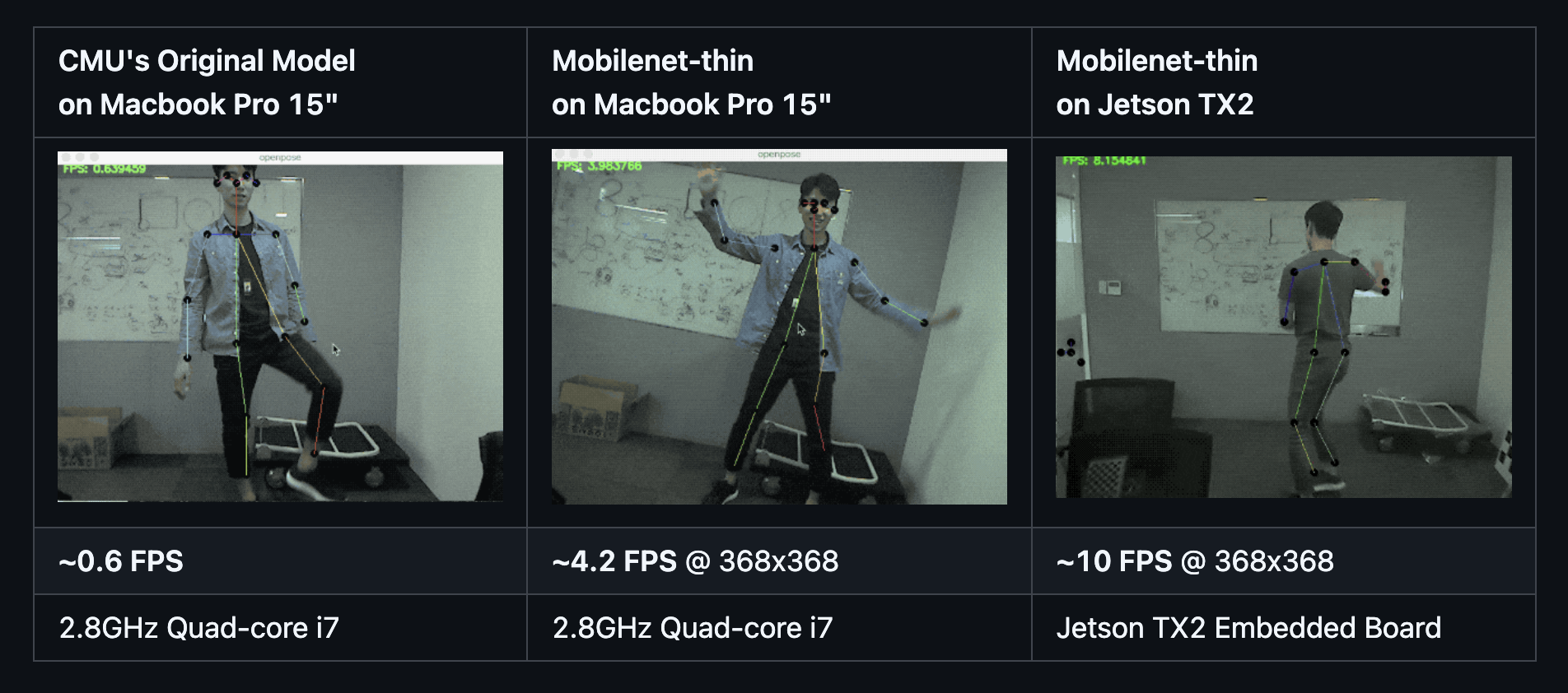

완전히 백지 상태에서 시작했지만, OpenPose를 활용한 운동 자세 평가 프로젝트를 하면서 인공지능을 처음 접했습니다. 당연히 아무것도 몰라 시행착오도 많았지만, 이 경험이 제 진로를 바꾸는 계기가 되었습니다.

4학년이 되어서도 코로나는 여전했지만, 더 깊이 배우고 싶다는 생각에 다른 학교 연구실에도 지원했습니다. 그리고 결국 그 학교에서 석사 과정을 밟게 되었죠.

석사 과정에서는 자연어 처리 연구를 이어갔습니다. 학부 연구생 시절 직접 트랜스포머를 구현해본 경험이 있었던 덕분에 NLP에 매료되었고, 관련 주제를 꾸준히 파고들었습니다. 그 결과 석사 동안 총 2편의 논문을 작성할 수 있었습니다.

두 번째 논문

https://arxiv.org/abs/2503.23363

Large Language Models Are Better Logical Fallacy Reasoners with Counterargument, Explanation, and Goal-Aware Prompt Formulation

The advancement of Large Language Models (LLMs) has greatly improved our ability to process complex language. However, accurately detecting logical fallacies remains a significant challenge. This study presents a novel and effective prompt formulation appr

arxiv.org

지원 전략: 어떻게 준비했나

저는 2025년 3월부터 본격적으로 지원을 시작했습니다. 총 24곳에 지원했는데, 무작정 넣은 것은 아니고 나름의 기준이 있었습니다.

크게 두 가지 원칙을 세웠습니다.

- 하고 싶은 일과 연결되는가?

- 자연어 처리, 대규모 언어모델, AI 응용과 같은 주제를 다루는 회사만 지원했습니다. 연구실에서 쌓은 경험을 살리고 싶었기 때문에, 단순히 “AI”라는 이름만 붙은 포지션보다는 제 연구와 이어질 수 있는 곳을 우선으로 했습니다.

- 배울 수 있는 환경인가?

- 첫 직장이니만큼 연봉이나 복지보다는, 얼마나 다양한 프로젝트에 참여하고 배우면서 성장할 수 있을지를 더 중요하게 봤습니다.

지원서를 준비할 때는 기본 뼈대를 하나 만들어 두고, 각 회사에 맞춰 조금씩 수정했습니다. 예를 들어 “연구 경험을 어떻게 설명할지”는 공통적으로 가져가되, 회사의 비즈니스 분야(예: 금융, 제조, 플랫폼 등)에 맞게 표현을 바꾸었습니다. 덕분에 시간이 절약되면서도 어느 정도 맞춤화된 지원서를 제출할 수 있었습니다.

결과적으로는 15곳에서 서류 탈락을 경험했습니다. 지금 생각해보면, “내가 하고 싶은 일”과 “회사가 원하는 사람” 사이의 간극이 컸던 것 같습니다. 하지만 이 과정을 통해 제 강점을 더 선명하게 정리할 수 있었고, 그게 후반부 합격에 큰 도움이 되었습니다.

코딩테스트 경험

AI 직무라고 해서 코딩테스트를 가볍게 생각하면 큰 오산입니다. 실제로 여러 기업에서 코테를 봤는데, 대부분은 알고리즘 문제 + ML 관련 문제 조합이었습니다.

제가 겪은 유형은 크게 세 가지였습니다.

- 전형적인 알고리즘 문제흥미로운 점은 최근 들어(2025 하반기) 일부 기업에서는 코테를 아예 제외하거나, 대신 과제 전형, 인적성을 도입하는 흐름이 생기고 있다는 점입니다.

- BFS/DFS, 구현, 완전 탐색 같은 기본기가 자주 나왔습니다. 난이도는 백준 골드~플래티넘 초반 수준이었고, “AI 직무인데 왜 이렇게 어렵지?”라는 생각이 들기도 했습니다. 하지만 기업 입장에서는 결국 문제를 빠르게 분석하고 해결하는 논리력을 보고 싶어 한다는 걸 느꼈습니다.

- 데이터 처리 문제

- 주어진 데이터셋을 전처리하거나 간단한 ML 모델을 학습시키는 유형도 있었습니다. 예를 들어 “문자열 파싱 후 통계 내기” 같은 문제로, 실무 데이터를 다루는 구현 능력을 확인하는 느낌이었습니다.

- 실습형 환경

- 일부 기업은 Colab 기반 환경에서 코테를 진행했는데, 인터넷이 차단되어 있어 라이브러리 문법을 외워두지 않으면 곤란했습니다. 미리 PyTorch 기본 템플릿이나 자주 쓰는 코드 패턴을 정리해 두는 게 큰 도움이 되었습니다.

돌이켜보면 코테 준비는 LeetCode, 백준, 프로그래머스를 꾸준히 병행한 것이 가장 효과적이었습니다.

특히 하루에 한 문제라도 푸는 습관이 중요했습니다. 코테가 합격/불합격을 100% 좌우하지는 않았지만, 면접으로 가기 위한 관문 역할을 한다는 점에서 필수적이었습니다.

결론적으로, AI researcher/engineer로 취업하기 위해서는 알고리즘 문제 풀이뿐만 아니라 ML, 딥러닝 기본기, PyTorch 구현 능력까지 함께 준비해야 합니다.

면접 경험

면접은 기업마다 스타일이 달랐습니다. 특히 대기업과 중소/스타트업의 차이가 뚜렷했습니다.

1. 대기업 면접

대기업은 의외로 인성·경험 위주의 질문이 많았습니다.

- 지원 동기 & 커리어 방향: “왜 우리 회사인가?”, “앞으로 어떤 연구자가 되고 싶은가?” 같은 질문이 기본이었습니다.

- 경험 기반 질문: “가장 어려웠던 프로젝트는 무엇이었는가?”, “협업 중 갈등이 생겼을 때 어떻게 해결했는가?”처럼 과거 경험을 어떻게 풀어내는지를 보는 경우가 많았습니다.

- 논리성과 태도 평가: 답변이 완벽할 필요는 없었고, 얼마나 논리적으로 정리해서 말하는지, 조직에 적합한 태도를 가졌는지를 중점적으로 본다는 느낌이 강했습니다.

즉, 대기업은 기술적인 디테일보다는 조직에 잘 적응할 수 있는 사람인가를 평가하는 쪽에 가까웠습니다.

2. 중소/스타트업 면접

반대로 중소·스타트업은 기술과 실무 능력에 초점을 맞추는 경우가 많았습니다.

- 구현 능력 확인: “PyTorch로 모델을 직접 짜 본 적이 있나?”, “데이터 파이프라인을 어떻게 구성했나?” 같은 질문이 나왔습니다.

- 깊이 있는 프로젝트 질의응답: 논문이나 프로젝트를 하나 집어 깊게 파고들며, 실제로 내가 맡았던 역할과 문제 해결 과정을 상세히 설명해야 했습니다.

- 문화 적합성: 작은 팀일수록 협업과 소통을 강조하기 때문에 “자율적인 환경에서 어떻게 일할 수 있는가?” 같은 질문도 있었습니다.

즉, 중소·스타트업은 실무에 바로 투입할 수 있는가와 우리 팀과 잘 맞는가를 동시에 평가한다는 느낌이었습니다.

멘탈 관리

취업 준비 과정에서 가장 힘들었던 건 사실 탈락 통보보다 통보를 기다리는 과정이였습니다.

총 24곳에 지원해서 15곳은 서류에서 떨어졌고, 몇몇은 정말 억울하다고 느껴질 정도였습니다. 특히 “내가 이 정도는 됐을 텐데 왜 탈락이지?” 하는 생각이 들 때마다 멘탈 관리가 어려웠습니다.

제가 버틸 수 있었던 방법은 크게 세 가지였습니다.

- 루틴 유지하기

- 떨어지고 나면 의욕이 확 꺾이는데, 그럴수록 정해둔 루틴을 지키려고 했습니다. 오전에는 코테 문제 풀이, 오후에는 자기소개서 수정이나 면접 준비, 저녁에는 가볍게 운동하는 식으로 일과를 만들었습니다. 덕분에 결과에 휘둘리지 않고 하루하루 쌓아갈 수 있었습니다.

- 작은 성취 쌓기

- 코테 문제 하나 풀기, 블로그 글 하나 쓰기, 논문 한 편 요약하기 같은 작은 목표를 세웠습니다. 합격/불합격은 내 손에 달린 게 아니지만, 이런 작은 성취는 제 멘탈을 지탱해주는 기반이 되었습니다.

- 탈락을 ‘과정’으로 보기

- 처음엔 탈락이 곧 실패라고 생각했는데, 나중엔 “아, 이건 그냥 과정이구나”라고 받아들이게 됐습니다. 어차피 합격은 한 번만 있으면 되는 거니까요. 실제로 후반부로 갈수록 탈락에 덜 흔들리고, 면접 준비에 더 집중할 수 있었습니다.

앞으로의 계획

이번 취업은 끝이 아니라 시작이라고 생각합니다. 제 목표는 단순히 산업에서 일하는 것에 그치지 않고, 현장에서 부딪히며 진짜로 연구하고 싶은 주제를 찾는 것입니다.

앞으로는 LLM을 제대로 이해하기 위해 데이터 수집 및 전처리 → 사전 학습(Pre-training) → 미세조정(Fine-tuning) → Post-training(Alignment: Instruction tuning, RLHF 등) 전반적인 파이프라인을 모두 경험해보고 싶습니다.

연구실에서는 모델의 일부 단계에만 집중했다면, 이제는 산업에서 데이터와 모델, 그리고 서비스까지 연결되는 흐름을 직접 보고 싶습니다.

이 과정을 통해 “산업이 지금 당면한 문제는 무엇인지, 그리고 학계 연구로 어떤 기여를 할 수 있을지”를 스스로 깨닫고 싶습니다. 그리고 그 경험을 토대로, 언젠가 다시 학문적인 연구를 이어갈 때 진짜로 의미 있는 주제를 다루고 싶네요..!

또한 장기적으로는 이직이나 커리어 전환도 염두에 두고 있기 때문에, 앞으로도 코딩테스트 문제 풀이를 꾸준히 이어갈 계획입니다. 코테 준비는 단순히 취업 과정의 관문을 넘기기 위한 것이 아니라, 제 커리어의 다음 단계를 준비하는 전략이기도 합니다.

결국 제 길은 실무와 연구를 잇는 다리를 놓는 것이라고 생각합니다. 그 첫걸음을 이제 막 시작했고, 앞으로 이 블로그에 그 여정을 꾸준히 기록해 나갈 예정입니다.

'취업할거야 > 회고' 카테고리의 다른 글

| 2026년 1월, 절반을 넘기며 (1월 19일 ~ 1월 25일 계획) (0) | 2026.01.18 |

|---|---|

| 2025년 회고 — 증명, 준비, 연결 (0) | 2025.12.31 |

| 상반기 취준 후기 - 취업은 쉽지 않다…! (5) | 2025.07.11 |

| 📝 CJ올리브네트웍스 AI 직무 서류부터 1차면접 까지의 회고 (2) | 2025.05.22 |